Als je de afgelopen weken het gevoel had dat Claude Code minder scherp was dan normaal, had je gelijk. Anthropic publiceerde gisteren een gedetailleerde postmortem over drie losse bugs die Claude Code tussen 4 maart en 20 april troffen. Samen zorgden ze ervoor dat het model trager dacht, context vergat en onnodig zuinig met woorden werd.

Drie bugs in zes weken

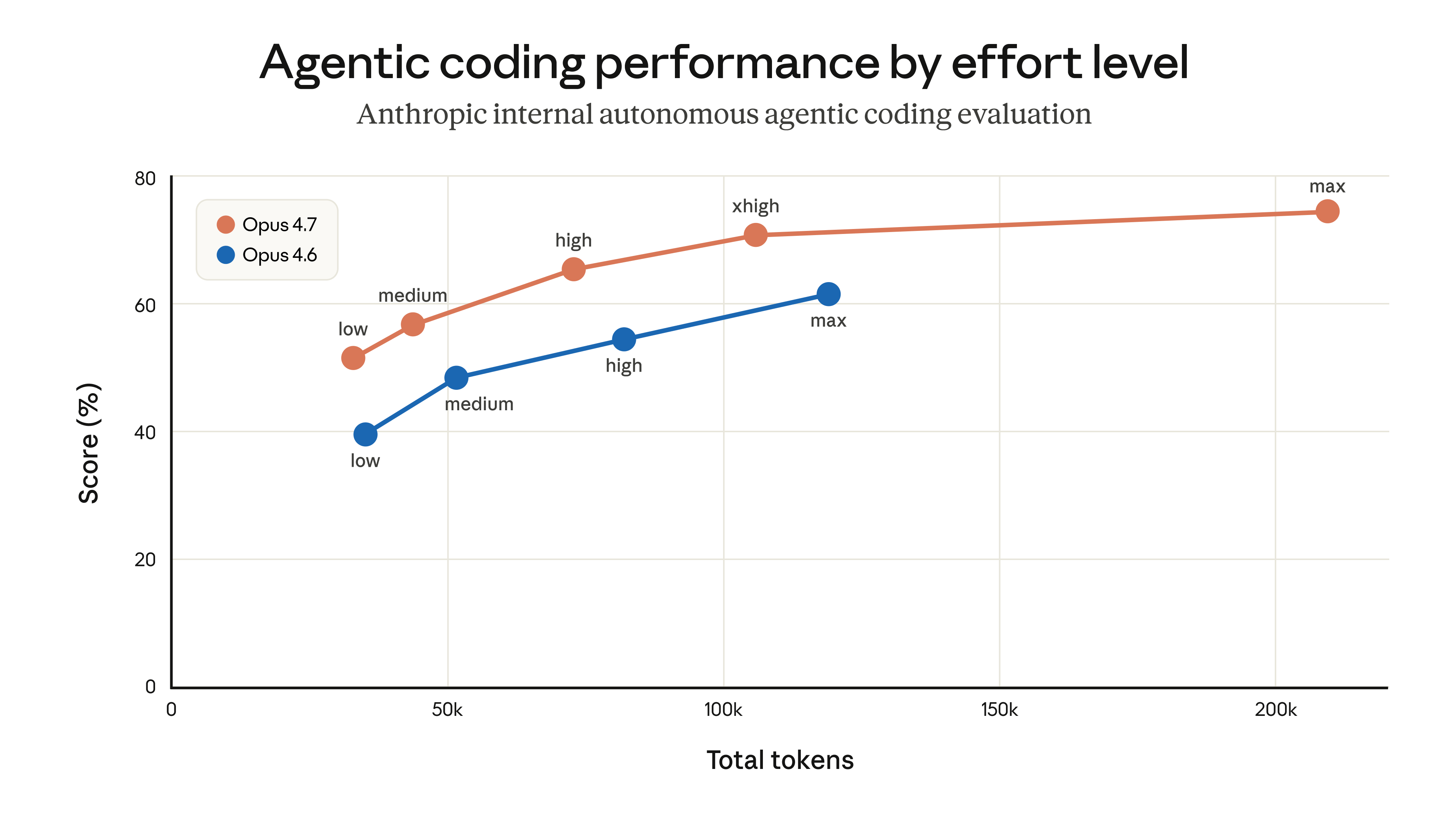

Het begon op 4 maart, toen de standaard reasoning effort van high naar medium werd gezet. Dat was bedoeld om UI-bevriezingen en trage reactietijden op te lossen, maar het bijeffect was dat Claude merkbaar oppervlakkiger antwoordde. Gebruikers rapporteerden dat het model "minder intelligent" aanvoelde. Het duurde 34 dagen voordat dit werd teruggedraaid.

Op 26 maart kwam daar een tweede probleem bij: een bug in de thinking-cache. Bij het verwerken van de clear_thinking API-header ging iets mis waardoor Claude elke beurt opnieuw zijn denkcontext kwijtraakte in plaats van alleen bij de eerste beurt. Het resultaat: vergeetachtigheid, herhalingen, vreemde toolkeuzes, en sneller opgebruikte gebruikslimieten. Die bug zat er vijftien dagen in.

Alsof dat niet genoeg was, voegde het team op 16 april een instructie toe aan het systeemprompt: "houd tekst tussen tool calls op maximaal 25 woorden". Bedoeld om de output compacter te maken, maar het kostte Claude drie procent op interne intelligentie-benchmarks. Na vier dagen werd ook die wijziging teruggedraaid.

Waarom het zo lang duurde

De combinatie maakte detectie lastig. Interne experimenten en interface-aanpassingen maskeerden de effecten in testomgevingen. Pas toen gebruikers massaal klaagden over kwaliteitsverlies, werden de problemen systematisch onderzocht. Dat is een les die verder reikt dan Anthropic: als je eigen monitoring de problemen niet oppikt maar je gebruikers wel, heb je een gat in je evaluatie-pipeline.

Wat Anthropic nu verandert

De postmortem somt vijf concrete maatregelen op:

- Gebruikslimieten gereset. Alle abonnees krijgen hun limieten terug voor de periode dat de bugs actief waren.

- Bredere evaluaties. Elke wijziging aan het systeemprompt wordt nu per model getest op intelligentie-impact, niet alleen op het doelmodel.

- Nieuw review-tooling. Promptwijzigingen doorlopen een audit-trail voordat ze live gaan.

- Geleidelijke uitrol. Wijzigingen die intelligentie kunnen raken worden stapsgewijs uitgerold met een verplichte observatieperiode.

- Verbeterde Code Review tool. Meer repository-context zodat Claude betere beslissingen neemt bij codereviews.

Wat dit betekent als je Claude zakelijk inzet

De transparantie van Anthropic verdient een compliment. Een publieke postmortem met tijdlijnen, oorzaken en maatregelen is in de AI-industrie nog zeldzaam. Maar het onderstreept ook een risico dat elke organisatie die op AI-tooling leunt moet erkennen: de kwaliteit van je LLM kan zonder waarschuwing veranderen door een update aan de providerkant.

Als je Claude Code gebruikt in je ontwikkelteam, is het verstandig om periodiek je eigen kwaliteitscheck te doen. Niet blind vertrouwen op de provider, maar steekproefsgewijs output vergelijken met eerdere resultaten. De drie procent intelligentiedaling door een 25-woorden-limiet in het systeemprompt klinkt klein, maar voor complexe refactors of architectuurbeslissingen is dat het verschil tussen een bruikbaar advies en een gemiste bug.