Op een luie maandag in 2025 typt Liam Price een wiskundig probleem in ChatGPT. Hij is 23, heeft geen wiskundediploma en verwacht eigenlijk weinig. Tachtig minuten later heeft hij een probleem opgelost dat de wiskundewereld al zestig jaar bezighoudt. Terence Tao, de meest gerenommeerde wiskundige ter wereld en Fields-medaillewinnaar, legt achteraf uit wat er misging: alle eerdere experts maakten bij stap één een kleine fout en bouwden zestig jaar voort op die aanname. GPT-5.4 Pro had die aanname niet. Het model kende de gewoonte niet.

Wat is een Erdős-probleem?

Paul Erdős (1913-1996) was de meest productieve wiskundige van de twintigste eeuw. Hij publiceerde meer dan 1.500 papers en liet na zijn dood een lijst van open problemen achter, elk met een geldprijs voor wie het oplost. Probleem #1196 gaat over zogenaamde "primitieve verzamelingen": verzamelingen van gehele getallen waarbij geen enkel getal een veelvoud is van een ander in diezelfde set. Erdős had een vermoeden over hoe die verzamelingen zich gedragen als de getallen oneindig groot worden. In 2022 bewees Jared Lichtman van Stanford al een deel van dat vermoeden in zijn proefschrift. Het tweede, hardere deel bleef open. Lichtman probeerde het zelf. Tientallen andere wiskundigen probeerden het. Niemand kwam door.

Eén prompt, tachtig minuten

Price deed niet wat wiskundigen normaal doen. Geen literatuurstudie, geen opbouw van intuïtie over jaren, geen hypotheses op het whiteboard. Hij kende het probleem eigenlijk niet eens. "I didn't know what the problem was — I was just doing Erdős problems as I do sometimes, giving them to the AI and seeing what it can come up with."

Zelf bekijken? Bekijk de volledige ChatGPT-sessie waarin het bewijs werd gegenereerd.

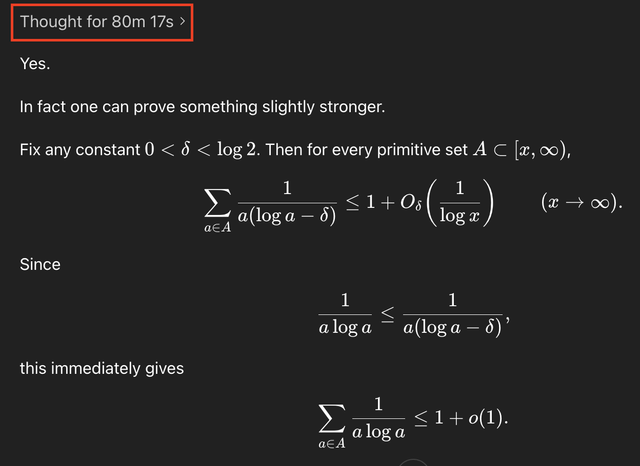

Hij plakte het probleem in GPT-5.4 Pro. Het model gebruikte Markov-ketens: een statistisch gereedschap dat allang bestaat in de wiskunde, maar dat niemand ooit op dit type probleem had toegepast. Niet omdat ze het niet konden. Maar omdat ze het gewoon nooit probeerden. Het zat niet in de standaard toolkit voor dit soort vraagstukken. De associatie was er simpelweg niet.

Tachtig minuten voor de oplossing. Nog dertig minuten om het als wetenschappelijk document op te maken. Onder de twee uur.

Waarom lukte een amateur wat experts 60 jaar niet lukte?

Dit is het deel dat Fields-medaillewinnaar Terence Tao zo scherp verwoordde. Tao is hoogleraar aan de UCLA, werkt decennialang aan open wiskundeproblemen en is een van de weinigen die de intellectuele diepgang van dit vraagstuk echt kon beoordelen. Zijn uitleg is direct:

"This one is a bit different because people did look at it, and the humans that looked at it just collectively made a slight wrong turn at move one."

Een kleine fout bij stap één. Daarna 60 jaar doorwerken op een fundament met een onzichtbare barst. GPT-5.4 Pro had dat fundament niet. Het model kent geen gewoonte. Het weet niet hoe wiskundigen "dit soort problemen aanpakken". Het pakt het gewoon anders aan. Kevin Barreto, een tweedejaars wiskundestudent aan Cambridge die Price hielp het resultaat te verifiëren, noemde het later "een creatieve stap die menselijke wiskundigen, ondanks jaren werk aan dit probleem, hadden gemist".

Wacht even. Wat er dus werkelijk gebeurde: een amateur gaf een AI-model een probleem zonder context, zonder bias, zonder de "dit doen we al jaren zo"-bril. Het model vond een aanpak die niemand had geprobeerd, niet omdat die aanpak onbekend was, maar omdat niemand er ooit op was gekomen hem hier te gebruiken.

"Vibe maths" als methode

Price en Barreto noemen hun werkwijze "vibe maths". Geen vaste methodiek, geen literatuuroverzicht, geen hypotheses vooraf. Gewoon een probleem ingooien, kijken wat eruit komt, herformuleren, doorvragen. Even voor de beeldvorming: dit is het tegenovergestelde van hoe de meeste bedrijven AI gebruiken.

De meeste medewerkers openen ChatGPT voor hun vaste takenpakket. Schrijf een mail. Maak een samenvatting. Vertaal dit document. Nuttig, maar het verandert niets fundamenteels aan hoe je denkt. Je gebruikt AI om bestaande processen sneller uit te voeren. Price gebruikte AI om een aanname te laten vallen die hij zelf nooit had kunnen loslaten, want hij had die aanname niet eens.

Denk aan het verschil tussen een medewerker die zijn weekrapportages sneller maakt met AI en een medewerker die AI vraagt: "Waarom doen we dit eigenlijk zo, en wat zou iemand doen die dit probleem voor het eerst ziet?" Het eerste is efficiënter. Het tweede is anders.

Wat dit voor jouw team betekent

Je hoeft geen Erdős-probleem op te lossen. Maar welk probleem in jouw bedrijf hangt al jaren als vanzelfsprekend aan de muur? Welke aanpak pakt jouw team steeds opnieuw op dezelfde manier op, zonder te vragen of die manier de beste is?

Ik kom dit dagelijks tegen bij klanten. Een e-commercebedrijf dat zijn voorraadbeheer al tien jaar op dezelfde manier inricht zonder ooit AI te vragen: "Welke aanname in dit systeem is eigenlijk nooit getoetst?" Een marketingbureau dat zijn contentstrategie altijd opzet op dezelfde drie pijlers, zonder ooit te vragen of een model zonder voorkennis tot een andere structuur zou komen.

Dat is de les van Price. Niet dat AI wiskunde kan. Maar dat AI geen gewoonte heeft. En jij kunt dat uitbuiten.

ChatGPT Pro, het abonnement waarmee Price dit deed, kost in Nederland €22 per maand inclusief btw. GPT-5.4 Pro is daarin inbegrepen. Dat is geen investeringsbeslissing. Dat is een koffiebudget per maand voor een denkpartner die jouw aannames niet kent.

Hoe je het morgen uitprobeert

Een concrete aanpak die voortborduurt op de "vibe maths"-methode van Price:

- Beschrijf het probleem zonder jouw oplossingsrichting. Leg uit wat het probleem is, niet hoe je het normaal aanpakt. "We verliezen klanten in de onboarding" in plaats van "We moeten onze onboarding-mails verbeteren".

- Vraag expliciet om een frisse blik. Niet "hoe kun je dit oplossen?" maar "Welke aanpak zou iemand kiezen die geen kennis heeft van hoe wij dit normaal doen? Welke aanpak zit niet in onze standaard toolkit?"

- Vergelijk de uitkomst met hoe jullie het normaal doen. Lijken de aanpakken te veel op elkaar, dan heeft het model jouw framing overgenomen. Herformuleer en probeer opnieuw.

- Leg de suggestie voor aan iemand buiten jouw team. Klinkt het logisch voor een buitenstaander? Dan ben je waarschijnlijk buiten je eigen denkkader gestapt.

Dit is niet wat de meeste AI-handleidingen je leren. De meeste gidsen gaan over hoe je AI beter stuurt naar een uitkomst die jij al voor ogen hebt. Hier gaat het om precies het tegenovergestelde: hoe je AI vraagt om jouw uitkomst te vergeten en opnieuw te beginnen. Meer over die aanpak schreef ik eerder in hoe ik met vijf agents tegelijk aan één project werk.

Wat Tao zegt over de bredere betekenis

Tao is voorzichtig, maar zijn conclusie is substantieel. "We have discovered a new way to think about large numbers and their anatomy." Hij verwacht dat de Markov-keten-aanpak van GPT-5.4 Pro doorwerkt naar andere gebieden in de getallentheorie. Niet alleen dit ene probleem is gekraakt, er is een nieuw gereedschap gevonden voor een hele klasse van wiskundeproblemen.

Op het moment van schrijven loopt de formele verificatie nog. Lichtman en Tao hebben het ruwe ChatGPT-bewijs opgepakt en de kernideeën eruit gehaald. De resultaten zijn gepubliceerd op het platform dat Erdős-problemen bijhoudt en hebben de aandacht van de internationale wiskundegemeenschap getrokken. Scientific American schreef er uitgebreid over.

Overigens is dit niet de eerste keer dat AI helpt bij wiskundig onderzoek. Maar het is volgens Tao een van de eerste keren dat het model niet een bekende techniek sneller toepast, maar een aanpak vindt die mensen nooit hadden geprobeerd. Geen optimalisatie, maar een omweg die een kortere route bleek.

Wat nu op jouw agenda staat

Er zijn twee dingen die je uit dit verhaal kunt halen.

Het eerste is praktisch: GPT-5.4 Pro is beschikbaar en de prijs is laag genoeg om het deze week zelf te testen op een probleem in jouw bedrijf waar je team al lang hetzelfde mee bezig is. Niet voor schrijftaken. Voor denkwerk. Gooi het probleem erin zonder jouw aanpak te noemen en kijk wat eruit komt.

Het tweede is strategischer. Tao's analyse, "a slight wrong turn at move one", geldt niet alleen voor wiskunde. Elke organisatie heeft processen die jaren geleden zijn opgezet op aannames die nooit zijn getoetst. De vraag is niet of jouw team die aannames heeft. De vraag is wie er als eerste een AI-model vraagt het zonder die aannames aan te pakken.

Eerder schreef ik over waarom ik bij AI-adoptie altijd begin met een prototype en over hoe je herhalend promptwerk in een team-skill stopt. Die twee artikelen sluiten direct aan op de aanpak die hier centraal staat.